Bonjour ! Aujourd’hui je vous emmène dans le cœur de la révolution des chatbots IA : les grands modèles de langage.

Pour comprendre au mieux le fonctionnement d’un LLM, voyons sous forme d’un mini récapitulatif chronologique les événements importants jusqu’à son apparition :

Années 2000 - Les corpus de texte

Sur l’Internet en plein boom, des corpus de données de plus en plus grands voient le jour. Dans son expansion majeure, de plus en plus de sites voient le jour, de plus en plus de contenus textuels apparaissent. C’est l’apparition des données utilisées pour les modèles de langage.

2013 - Word2Vec

Nous sommes en 2013. Chez Google, cinq chercheurs présentent Word2Vec.

Qu’est-ce que Word2Vec ? Il s’agit en fait d’une technique appartenant au traitement du langage naturel (appelé NLP, Natural Language Processing) qui permet d’obtenir des représentations vectorielles de mots. En pratique, cela permet de regrouper des mots similaires selon leur signification (déduite grâce au contexte).

Ainsi, des mots comme « walk » (marcher) et « ran » (couru) seront proches, c’est-à-dire que leur sens sera reconnu comme similaire. Cette technique permet plusieurs actions, notamment de retrouver des synonymes, ou encore de proposer des mots similaires pour constituer des segments de phrases.

C’est la première fois qu’un modèle encode des relations sémantiques (suivant le sens : par exemple « roi - homme + femme ⇒ reine »).

2014 - Seq2Seq

Une équipe chez Google Brain (ancienne division regroupée aujourd’hui sous la division Google AI de Google DeepMind) conçoit Seq2Seq, un système conçu pour transformer une séquence en une autre.

Seq2Seq fonctionne en encodant le texte d’entrée. L’encodeur transforme le texte en une représentation interne. La représentation constitue un vecteur, une espèce de « résumé du sens ».

Ensuite, un décodeur génère la sortie, un mot après l’autre, en se basant sur ce vecteur. Concrètement, cela permet de traduire un texte, en tenant compte d’un certain contexte au lieu de la traduction mot par mot.

2017 - La révolution du transformer

En 2017, huit chercheurs de Google publient un article scientifique (désormais mythique : « Attention Is All You Need ») présentant le Transformer.

L’arrivée du Transformer constitue en quelque sorte un changement de paradigme dans l’univers des modèles de langage.

Le Transformer intègre le mécanisme « d’attention » (ce mécanisme est déjà apparu peu avant, mais c’est la première fois qu’il est utilisé par toute l’architecture). Au lieu de « lire » le texte d’entrée mot par mot, comme le faisaient les modèles Seq2Seq, le Transformer traite simultanément tous les mots (on parle de parallélisation totale), ce qui permet ainsi de traiter le texte beaucoup plus rapidement, mais aussi de gérer des phrases plus longues, en gardant la cohérence.

Comment se représenter le mécanisme d’attention ? L’attention est en fait la capacité à calculer les mots qui doivent être liés les uns aux autres, et avec quel degré d’importance. Chaque mot devient le centre d’un ensemble de liens plus ou moins importants avec les autres mots.

Le Transformer reprend aussi l’encodeur et le décodeur.

Avec l’apparition du Transformer, les jalons des LLM ont été posés. Dès lors, ce fut le début d’une série de sorties de recherche qui menèrent finalement à l’apparition des premiers produits commerciaux.

2018 - GPT-1

Un an après l’article de Google, en juin 2018, le jeune laboratoire de recherche OpenAI sort un papier intitulé :

« Improving Language Understanding by Generative Pre-Training » dans lequel était présenté le premier LLM Transformer pré-entraîné, nommé GPT-1 (les initiales de Generative Pre-trained Transformer). GPT-1 fut le premier modèle Transformer de grande taille appliqué au langage. Il avait 117 millions de paramètres (et en comparaison, on estime que GPT-5.1 a entre 2 et 3 billions, en français, soit 2 à 3 mille milliards, de paramètres !).

Les paramètres d’un LLM constituent les réglages internes que le modèle apprend pendant son entraînement. Cela signifie que chaque réglage est une manière de connecter les connaissances, de créer des liens. Les paramètres constituent en quelque sorte la capacité de raisonnement du modèle. C’est une notion difficile à expliquer, car très abstraite. Comme représentation, on peut avoir une table de mixage. Les paramètres constitueraient les réglages des boutons de la table.

2018 - BERT

La même année de la sortie de GPT-1, Google lance BERT (pour « Bidirectional Encoder Representations from Transformers »), le premier modèle bidirectionnel (ce qui signifie qu’il a la capacité de « regarder » à gauche mais aussi à droite dans une phrase). BERT démontre une très bonne compréhension et dépasse tous les benchmarks (ce sont des indicateurs de performance dans un domaine donné).

Une caractéristique de BERT était cependant de n’être qu’un encodeur. Il ne produisait pas de texte, ce n’était pas un modèle génératif.

Après ces principales sorties, un enchaînement a suivi…

2019 - GPT-2

En 2019, OpenAI sort GPT-2. Avec 1,5 milliards de paramètres, le modèle devient le premier à pouvoir créer des textes fluides, longs et cohérents.

2020 - T5

Développé par Google, T5 (pour « Text-to-Text Transfer Transformer ») est un modèle représentant toutes les tâches en texte. Concrètement, cela signifie que les tâches sont toutes effectuées comme étant un travail sur du texte. Cela permet de très bonnes performances en NLP (Natural Language Processing).

2020 - GPT-3

Avec ses 175 milliards de paramètres, GPT-3 marque un saut en étant beaucoup plus puissant que les modèles précédents.

2022 - Chinchilla

En 2022, Google DeepMind crée Chinchilla (Chinchilla n’est pas un modèle mis publiquement à disposition, mais un papier de recherche). Chinchilla redéfinit les normes, en démontrant de manière scientifique que les modèles d’alors sont sous-entraînés et surdimensionnés.

En effet, les modèles possèdent bien plus de paramètres qu’il n’en faut, et ne sont pas assez entraînés sur des données. C’est comme imaginer une personne avec une grande capacité intellectuelle mais sans connaissances, et une autre avec une capacité intellectuelle réduite mais davantage de connaissances. La seconde personne sera plus « intelligente ». Les LLM ont aussi besoin d’une grande quantité de données avant d’avoir de nombreux paramètres. C’est ce qu’a démontré Google DeepMind avec Chinchilla.

2022 - BLOOM

En 2022, avant la sortie de ChatGPT, BLOOM voit le jour. BLOOM (pour « BigScience Large Open-science Open-access Multilingual Language Model ») est le premier LLM open source de cette taille, initié notamment par HuggingFace dans le cadre du projet collaboratif international BigScience, soutenu par des institutions telles que le CNRS et GENCI.

BLOOM est le premier modèle open source de cette importance et marque ainsi le début du développement open source des LLM.

2022 - GPT-3.5

Le 30 novembre 2022, OpenAI sort avec accès public gratuit ChatGPT, basé sur GPT-3.5. C’est le premier LLM moderne accessible publiquement. Très rapidement, les médias en parlent, créant un véritable remous autour de la sortie. En 2023, ChatGPT compte plus de 100 millions d’utilisateurs.

2023 - LLaMA 1

En février 2023, Meta AI (filiale de la société mère de Facebook Meta) sort LLaMA 1 (pour « Large Language Model AI »). C’est la première fois qu’un LLM de cette importance est publié en une sorte d’open source, accélérant le développement de LLM indépendants et open source (déclenchement des créations de Mistral, Gemma, Phi, Qwen, etc.). Une des particularités de LLaMA est d’avoir été publié sous quatre tailles : en 7B (milliards), 13B, 33B et 65B, en gardant une excellente performance qui rivalise dans certains aspects avec GPT-3, mais beaucoup plus petits, permettant même de fonctionner sur des appareils comme des ordinateurs personnels (le fonctionnement local est aujourd’hui très évolué et il existe des centaines d’options disponibles ! Nous verrons cela ensemble…)

Voilà, nous venons de voir une espèce de chronologie de l’apparition technologique des LLM !

Bien entendu, dans ce récapitulatif chronologique, je n’ai pas fait mention de nombreux autres développements importants ou d’autres sorties de produits (notamment Mistral de Mistral AI ou Perplexity de Perplexity AI)…

Au fur et à mesure, nous verrons d’autres aspects techniques de ces LLM, qui constituent une véritable révolution…

Merci beaucoup, j’espère vraiment que cette première newsletter vous a plu, et je me réjouis de continuer !

À très bientôt !

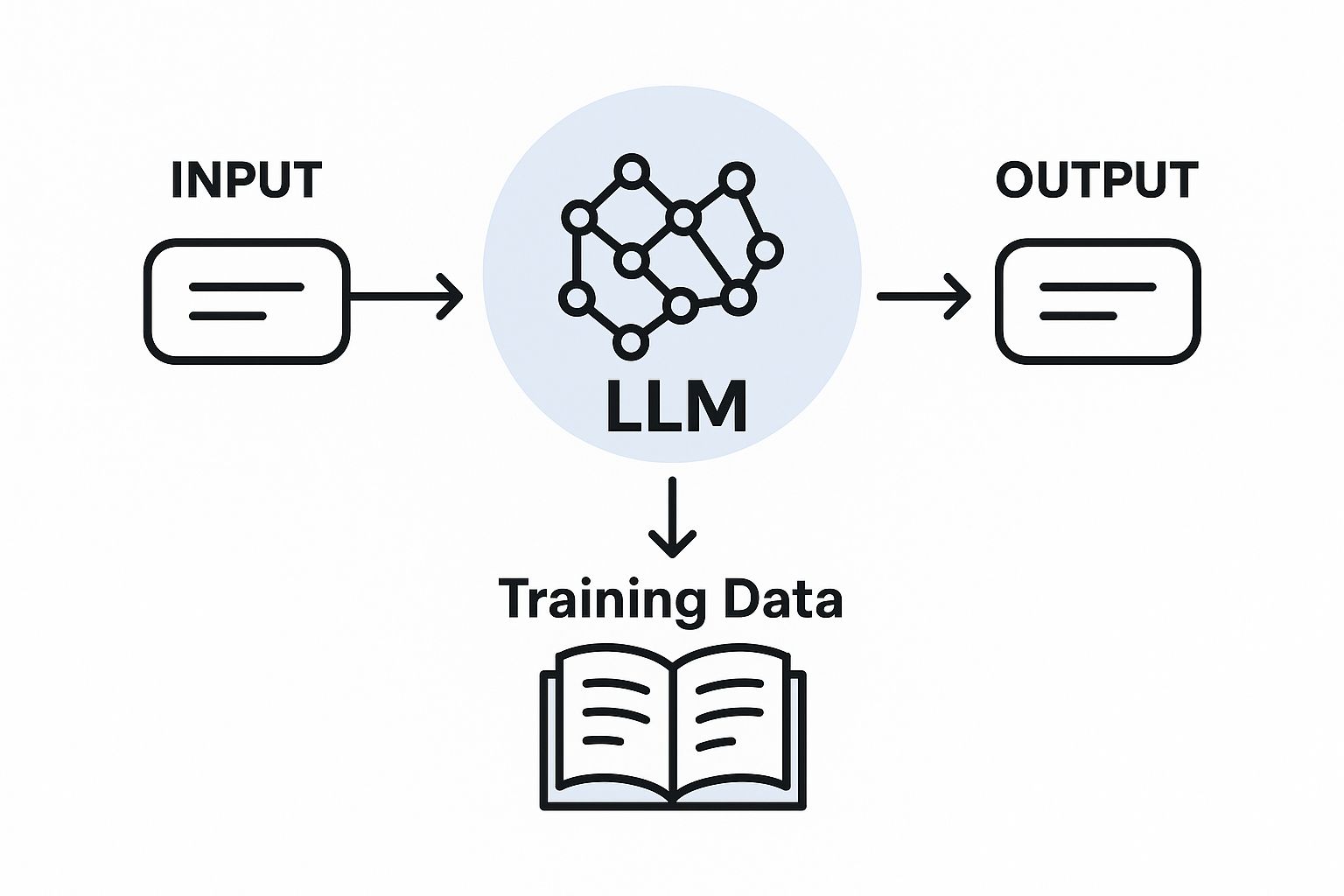

Visuel généré avec ChatGPT – modèle d’images OpenAI